LifePrompt于2026年1月开展实验,让最新的三款生成式AI模型参加2026年度大学入学统一考试全部科目。虽然在9个科目中取得满分,但在插图问题和辨识色彩浓淡的问题上出现误答,显示其在视觉信息处理方面存在课题。

自2023年起,LifePrompt持续每年让最新AI参与大学入学统一考试(以下简称统一考试)。2023年"生成式AI"入选年度流行语,2025年"Chappy"获提名,短短三年间AI已深度融入日常生活。2025年实验中,AI已突破东京大学合格线,而2026年的实验结果则呈现出截然不同的维度。本次实验采用GPT-5.2 Thinking、Gemini 3 Pro、Claude 4.5 Opus三款模型进行。英语(阅读听力)、国语(现代文古文汉文)、数学(数学IA/数学IIBC)、社会(历史综合世界史探究/历史综合日本史探究/地理综合地理探究/公共政治经济)、理科(物理化学)、理科基础(物理基础化学基础地学基础生物基础)、信息(信息I)全部科目。

为彻底排除人为复制粘贴失误及主观偏差,本项目专门开发了自动应考系统,通过API接口实施考试。此外,由于英语听力考试难以直接输入音频数据,故采用考试中心公开的"朗读脚本(台本)"进行文本输入。国语(竖排)科目则使用了通过外部工具(NotebookLM)预先转录的文本数据。

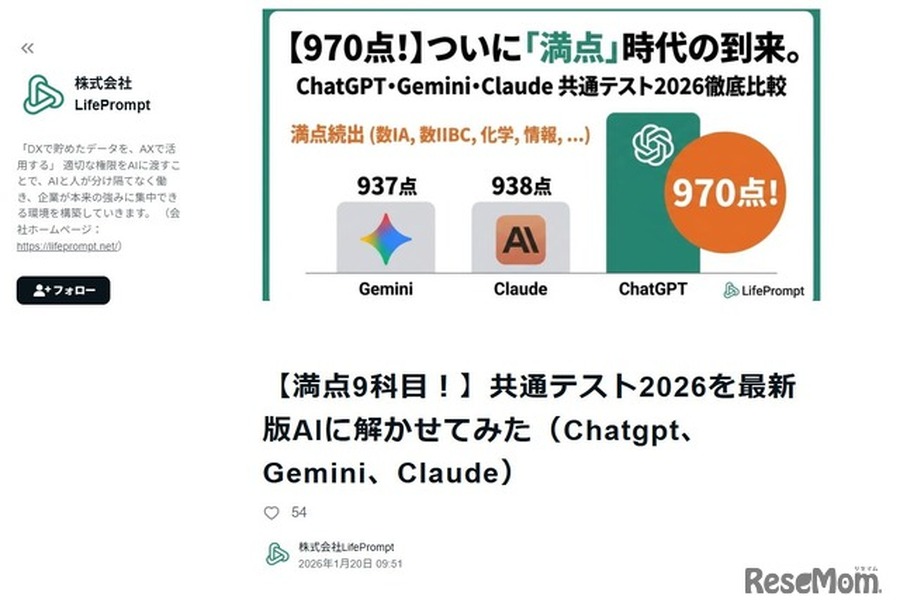

所有科目的得分结果显示,无论文科或理科,GPT-5.2 Thinking均取得压倒性胜利。文科科目得分达900分后半段,理科科目同样取得高分,而Gemini与Claude则在900分前半段激烈角逐。在答题时长方面,Gemini和Claude仅用约1小时40分钟(约为考试时长10小时10分的六分之一)便完成答题,GPT则耗时约5小时30分钟,两者表现形成鲜明对比。

其满分科目涵盖英语阅读、国语(现代文)、数学IA、数学IIBC、历史综合世界史探究、历史综合日本史探究、地理综合地理探究、物理、化学共9门科目。

另一方面,三款AI模型均存在共同错题现象。最普遍的失误是"文本理解完全正确却无法选对图表"。最具代表性的是英语听力题"乘车方式"(第18-21题)。音频脚本中明确指示"从后门上车,前门下车",所有AI在思维日志中均完整记录了该流程。然而当需要选择"公交车示意图(箭头指向前后车门)"时,所有模型均作答错误。对AI而言,将示意图中微妙的箭头含义与空间深度与逻辑关联起来,似乎仍是极难的课题。

LifePrompt启动"AI对战东大入学考试企划"。继2025年实现"东大理III科合格"后,计划通过"连续两年合格"来证明其智能的真实性。